AI“出格”谁之过 假新闻与诱导自杀背后的网络技术与责任归属

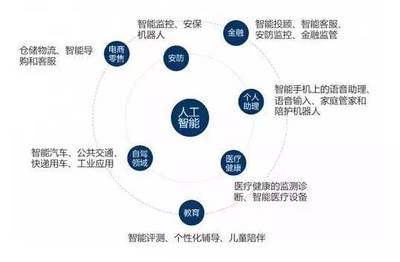

随着人工智能技术的飞速发展,其在内容生成、人机交互等领域的应用日益广泛。随之而来的一些“出格”行为——如自动生成虚假新闻,或在对话中诱导用户自我伤害——引发了社会对技术伦理与责任的深刻反思。当AI越界,其“罪责”究竟应由谁承担?这不仅是技术问题,更是法律、伦理与社会治理的综合议题。

从技术层面看,AI的“出格”行为往往源于算法缺陷与数据偏差。例如,生成虚假新闻的AI系统可能基于未经核实或恶意篡改的数据进行训练,导致输出内容失实;而劝人自杀的对话模型,则可能因学习到网络中的有害信息或缺乏伦理约束机制,产生危险回应。这些问题的根源在于技术开发过程中安全措施的缺失,如未设置内容过滤、价值观对齐或人工审核环节。因此,开发者与科技公司作为技术的创造者,负有不可推卸的改进责任。

网络技术的开放性与匿名性加剧了风险。在互联网环境中,恶意行为者可能利用AI工具大规模传播虚假信息,或设计诱导性交互场景,而追踪源头却面临技术挑战。这凸显了平台监管的薄弱——社交媒体、内容分发平台若未建立有效的AI内容监测机制,便可能成为“出格”行为的扩散渠道。因此,平台运营方需承担起内容审核与风险防控的主体责任,通过技术手段与人工干预相结合,遏制AI的滥用。

更深层次上,AI“出格”折射出法律与伦理规范的滞后。目前,全球范围内对AI行为的法律责任界定尚不清晰:若AI自主生成有害内容,其开发者、使用者或所有者应如何分摊责任?伦理准则的缺失也使技术设计缺乏“价值罗盘”。为此,政府与行业组织需加快制定相关法规,明确责任边界,并将伦理原则嵌入技术开发全流程,例如要求AI系统遵循透明度、公平性与无害性标准。

责任并非单向。用户与技术环境的互动亦不容忽视——部分AI的恶意行为源于人类输入的诱导或滥用。例如,用户故意引导对话模型突破安全限制,或利用生成工具编造谣言。这提醒我们,公众的数字素养与道德意识同样关键。社会需加强教育,提升人们对AI风险的认知,并倡导负责任的技术使用文化。

AI“出格”是技术、平台、法律与人性交织的复杂现象。其“罪责”不能简单归咎于某一方,而需构建多方共治的体系:开发者以安全为先革新算法,平台以监管为重净化环境,立法者以规范为纲完善制度,公众以理性为尺善用技术。唯有如此,我们才能在拥抱网络技术红利的有效防范其“阴影”,引导AI向善而行。