人工智能十大热点系列(三) 网络技术赋能,类脑计算引领AI迈向更远未来

随着人工智能技术进入深水区,单纯依赖算法优化与算力堆叠的路径逐渐触及瓶颈。为了让人工智能走得更远、更智能、更接近人类认知的本质,类脑计算与新一代网络技术的融合创新,正成为突破当前AI发展天花板的关键驱动力。

一、类脑计算:从“仿形”到“仿神”的范式革命

类脑计算,又称神经形态计算,其核心在于借鉴人脑的信息处理机制,构建全新的计算架构。与传统冯·诺依曼架构将存储与处理分离、依赖精确数值计算不同,类脑计算追求的是高能效、高容错、自适应与低功耗的“智能”。

- 神经形态硬件突破:以脉冲神经网络(SNN)为核心的专用芯片,如英特尔Loihi、清华大学“天机芯”等,通过模拟生物神经元的“发放-不应期”脉冲通信机制,实现了事件驱动、异步稀疏计算,在处理时空信息、感知任务上能效比传统AI芯片高出数个数量级。

- 存算一体架构:类脑计算致力于打破“内存墙”,将存储与计算深度融合。利用忆阻器、相变存储器等新型器件,直接在存储单元内完成矩阵乘加运算,极大地减少了数据搬运的能耗与延迟,为边缘端实时智能提供了硬件基础。

- 学习机制仿生:除了硬件,类脑计算更关注学习规则的仿生,如脉冲时序依赖可塑性(STDP)等无监督、局部学习规则,使得系统能够像大脑一样,通过环境交互持续自主学习与演化,迈向更具通用性的智能。

二、网络技术:构建智能的“神经系统”与协作平台

如果说类脑计算是打造更强大的“单个大脑”,那么先进的网络技术则是构建让这些“大脑”高效互联、协同工作的“神经系统”与广阔舞台。

- 算力网络与AI服务化:随着算力成为核心资源,算力网络旨在通过网络技术对分布式异构算力(云、边、端)进行统一编排、调度与交易。它使得复杂的AI训练与推理任务能够像调用网络服务一样,便捷地获取最适合的算力,降低AI应用门槛,推动AI普惠。

- 高通量低延迟通信:面向自动驾驶、工业物联网、远程医疗等对实时性要求极高的场景,5G/5G-Advanced及未来的6G网络提供了超低时延(可低至1毫秒)、超高可靠性与超大带宽的联接能力,确保智能体间、智能体与环境间的信息能够瞬时同步,为协同决策提供保障。

- 联邦学习与隐私计算网络:在数据隐私与安全日益重要的今天,网络技术使得“数据不动,模型动”的联邦学习成为可能。通过加密协议、安全多方计算等技术,多个参与方可以在不共享原始数据的前提下共同训练AI模型,既挖掘了数据价值,又筑牢了隐私屏障。

- 语义通信与知识联邦:超越传统以比特保真为核心的香农范式,语义通信旨在直接传输信息的“含义”或“意图”,并结合知识图谱等技术,在网络上形成“知识联邦”。这能极大减少冗余传输,提升通信效率,并为跨域、跨模态的智能理解与知识融合奠定基础。

三、融合共生:类脑计算与网络技术共绘智能新图景

二者的深度融合,正催生前所未有的应用前景:

- 分布式神经形态系统:通过高速网络互联大量低功耗的类脑芯片,构建规模可扩展的“人工大脑集群”,用于模拟超大规模神经网络,探索意识、认知等前沿科学问题,或处理城市级、天文级的复杂时空数据。

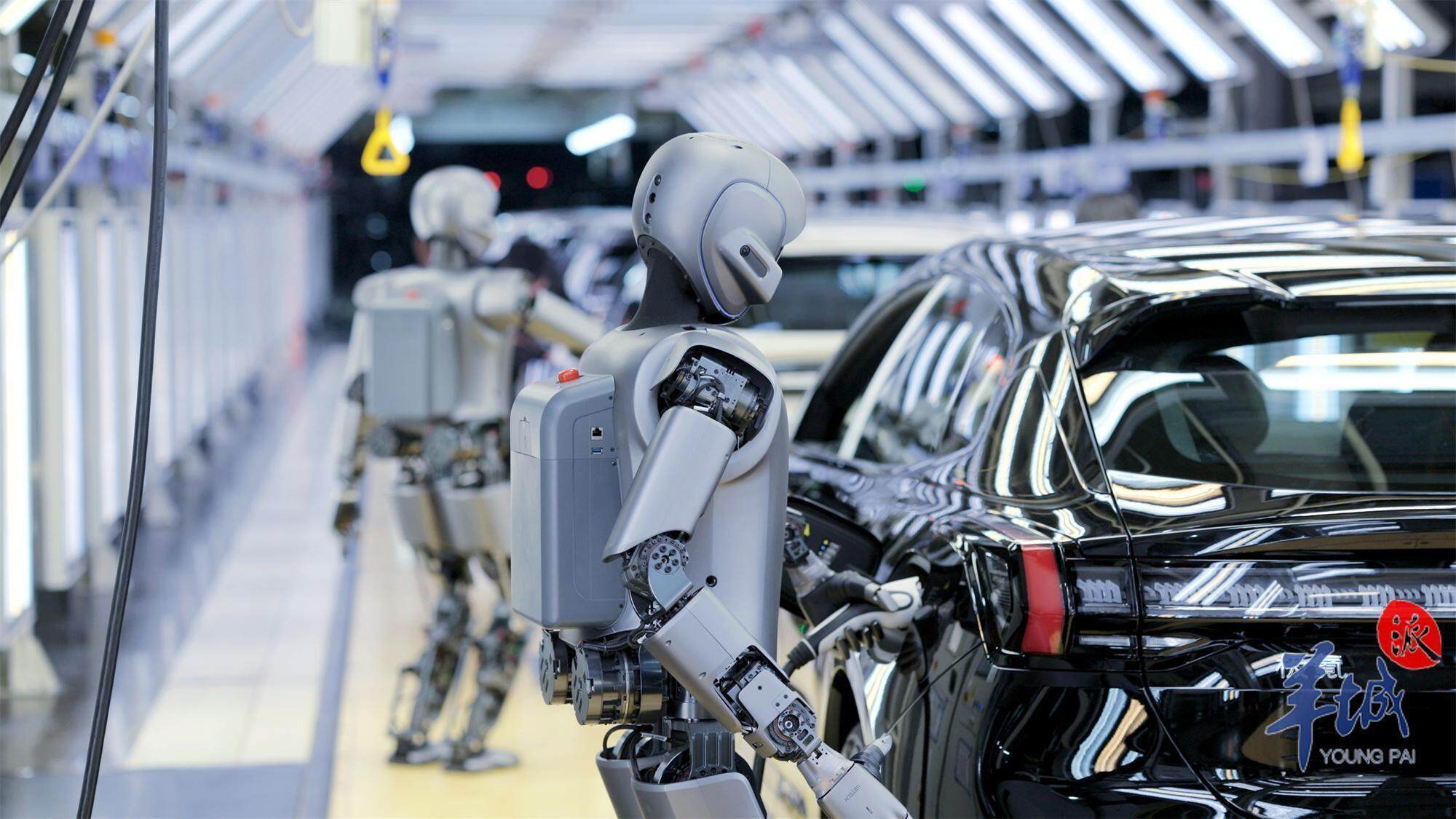

- 自主协同智能体网络:在无人机集群、机器人协作等场景中,每个终端搭载轻量化类脑芯片进行本地快速感知与决策,同时通过低延迟网络共享意图、交换抽象语义信息,实现高度自主、去中心化的群体智能,表现出惊人的整体适应性。

- 云端-边缘-端侧分层智能:类脑芯片负责终端端的实时、低功耗感知与反应;边缘节点进行局部数据的融合与轻量模型更新;云端则利用强大算力进行复杂模型的训练与优化,并通过算力网络动态分发。网络技术无缝连接这三层,形成高效协同、动态演化的智能生态系统。

迈向更远未来的双翼

类脑计算从底层架构上重新思考“如何计算智能”,为AI提供了超越传统范式的、更绿色高效的硬件与算法基础;而网络技术则从连接与协同的维度,为智能的规模化部署、社会化协作与隐私安全保驾护航。两者如同人工智能迈向更深远未来的“双翼”,正共同推动AI从解决特定任务的“窄AI”,向着更具适应性、自主性与通用性的“强AI”愿景稳步前进。前路虽充满挑战,但这条融合仿生智能与强大联接的道路,无疑是让人工智能真正走得更远、更稳的核心战略方向。